- 資源

選擇 AI 譯後編修的理由

以過去無法實現的幅度,大舉提升多語言內容交付的速度、擴展能力與成本效益。

對那些野心勃勃、設有遠大成長目標的組織來說,他們往往會面臨日漸沉重的壓力,必須得要更快速地以更具成本效益的方式,大規模地產出多語言內容。但傳統的翻譯方法經常會形成瓶頸,不但難以跟上全球需求增加的腳步,也無法在所有語言和地區間維持一定的品質。對許多組織來說,這意味著會累積大量的待處理翻譯工作,因而縮限了他們的能力,一方面無法及時觸及新目標對象,另一方面也難以迅速因應不斷變化的市場需求而調整。

AI 譯後編修 (自動譯後編修) 可以改變這個情況。將使用神經機器翻譯 (NMT) 或是檢索增強生成 (RAG) 所生成的機器翻譯結果,與先進的代理式 AI 譯後編修提示鏈和精準的人類監督相結合,我們得以大幅加快內容交付的速度並降低成本,推動速度與擴展能力再上層樓。

Lionbridge 的 AI 譯後編修解決方案能滿足許多內容需求,並可針對不同的語言、產業和品質要求提供可調整設定的工作流程。這個創新的做法能協助公司企業:

- 克服翻譯障礙

- 維持所期望的品質

- 拓展其全球觸角

Lionbridge AI 譯後編修解決方案的運作方式

AI 譯後編修運用了先進的大型語言模型 (LLM) 及精心打造的進階代理式提示鏈,能進一步調整與改善機器生成的翻譯。透過將大部分的譯後編修流程自動化,AI 譯後編修可大幅減少人力需求,讓專家們得以專注處理那些需要專業審閱或驗證的特定內容。

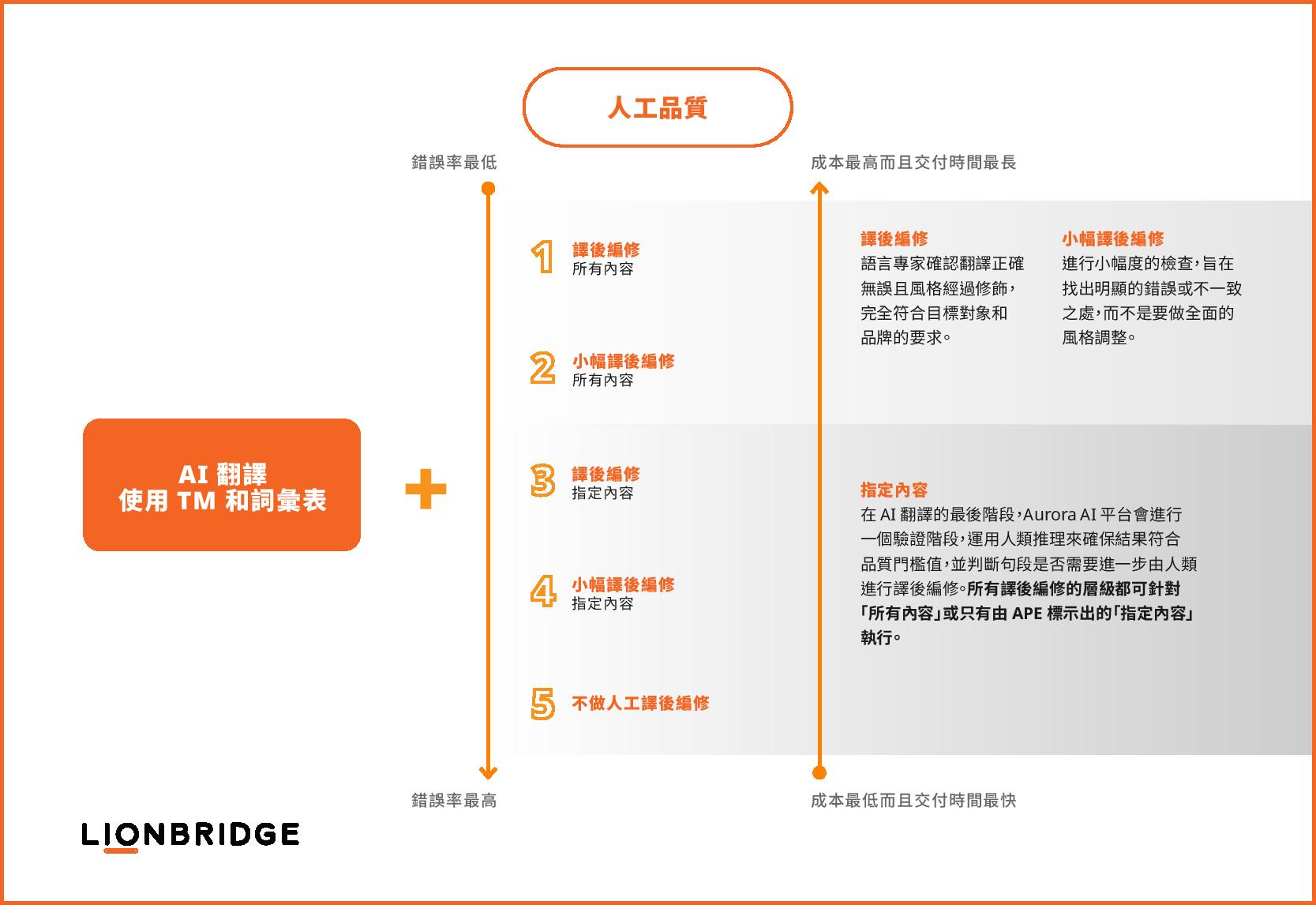

以下概略介紹納入 AI 譯後編修功能的 Lionbridge 解決方案。

選擇 Lionbridge AI 優先翻譯解決方案的理由

Lionbridge 先進的代理式本地化方法能提供可自訂的翻譯流程,進而減少人力需求

以最合適的 MT 解決方案進行翻譯,並以優異的前沿 LLM 進行 AI 決策判斷與編修

不需進行費時或昂貴的 NMT 或 LLM 訓練

根據內容進行 LLM 決策判斷

整合語言資產 (TM、詞彙表和風格指南)

能根據您要求的語氣或品牌調性自訂提示

對符合 TM 模糊比對的翻譯進行 LLM 譯後編修

以人類推理為基礎的進階內容驗證

「我們提供的是以成果為導向的做法,而不是一體適用的解決方案。透過不同程度的人類參與選項,您可以根據自己的內容需求選擇最相稱的做法,並以可量化的缺失率來評量品質。對許多語言與內容類型來說,即使錯誤率較高,也仍舊在人們可接受的範圍內。」

—Lionbridge 全球解決方案副總裁 Simone Lamont

Lionbridge 自動譯後編修解決方案的好處

翻譯量增加、速度變快、成本降低,同時又能維持品質

內容擴展能力

能翻譯超乎您想像的大量內容;運用專為持續進行大規模本地化工作的解決方案,將您內容的觸及範圍拓展至更多語言和市場。

速度

能將多語言內容的交付速度提升至前所未見的程度,不但可大幅縮短產品全球上市的所需時間,還可同時以多種語言發布內容。

成本效益

AI 譯後編修工作流程除了能交付高品質的輸出,與傳統的本地化做法相比費用更是低廉許多,能讓您以前所未有的實惠成本進行翻譯。

閱讀精彩內容,了解更多資訊

了解 AI 譯後編修:常見問答

我們深知正確性一直以來都是 MT 解決方案的一個挑戰。因此,Lionbridge 運用自動化品質評估功能,將 AI 優先的做法與人機迴圈機制相結合,進而得以隨時掌握正確性。

我們會運用 AI,來提升例如翻譯記憶庫 (TM)、神經機器翻譯 (NMT) 和 RAG 等傳統工具所產出的翻譯輸出。

根據我們在 AI 譯後編修上的經驗來看,它確實可以滿足對規模擴展能力的需求並維持品質。儘管如此,還是有必要透過人類監督來監控與調整這個工具,確認其正確性並滿足特定的內容需求。

我們的 AI 譯後編修解決方案一開始會先針對來源內容進行初始評量,了解其整體脈絡。掌握這個脈絡後,便會接著執行編輯與驗證步驟,確保產出的翻譯符合內容的目標和/或特色。

我們在設計 AI 譯後編修解決方案時納入了設定功能,讓使用者可以根據自動監控功能,以及參與翻譯流程之語言專家及客戶主題專家 (SME) 的意見回饋,來編輯與更新語言提示。

除此之外,Lionbridge 也提供其他 AI 解決方案,讓我們得以執行來源分析並製作報告,找出對來源內容的修改建議。這些解決方案還可以搭配我們的 AI 譯後編修解決方案,進一步最佳化內容策略。

我們的 AI 譯後編修解決方案可讓我們定義並找出最值得語言專業人員參與的地方。

我們會利用 REACH 架構,與客戶一同評估內容目標並設定 AI 解決方案,進而最佳化翻譯的輸出。接著我們可以定義不同程度的人類參與,確保這些心力的層級符合內容的需求和特色。

處理因語言和地區而異的產業專有術語不是件容易的事,但可以透過幾種方式解決。

透過運用中繼資料,我們可以提供更廣泛的脈絡給 AI 工具,並指示 LLM 處理額外的要求,例如地區細微差異等,但前提是內容必須先妥善地標記與標示。Lionbridge 的資料服務可以提供相關支援,協助公司企業達成這個先決條件。

對於那些必須依行政地區或地區調整的術語,我們會使用 RAG 架構來處理。在進行 AI 譯後編修時,我們會為 LLM 建立指引,要它根據定義好的語言規則執行特定動作。

您也可以運用我們解決方案的設定功能,去參考外部資料做為補充範例,協助 LLM 生成更符合特定脈絡的內容。

由於這類型的內容往往會隨時間演變,因此也必須要維護與更新語言提示。所以我們在建置 AI 解決方案時,亦特別設計可透過人類監督來加以控管和篩檢。

可以,我們的 AI 優先平台解決方案不受特定 LLM 所限制,亦沒有綁定任何特定的模型。它雖然是用 OpenAI GPT 的模型再加以校正,但我們可以跟客戶合作,改為運用客戶自己的 LLM 引擎。

這種情境屬於自訂設定,可能需要進行更多的評估/設定,以確認該 LLM 符合品質標準。

關於這類解決方案,建議您與我們的解決方案和語言技術團隊協力合作,了解相關的需求、目標和要求。

我們的 AI 譯後編修解決方案具備可設定的語言提示功能,可因應不斷變化的內容需求及法規要求加以調整。儘管我們提議採用 AI 優先的流程,但語言提示的控管與篩檢仍舊是交由計算語言專家、主題專家 (SME) 和語言專業人員等人類負責,由他們進行最佳化和校正。

那些未經訓練、聊天機器人式的常用 LLM 模型,往往難以處理語氣、內容和文化上的細微差異。我們的解決方案處理這個挑戰的方式,就是使用可設定的提示鏈這個做法,提供 LLM 明確的指示,清楚定義風格、語氣和術語,以及跟原本內容脈絡相關的語言指引。透過可控管的語言參數和提示設定,我們便能運用 AI 譯後編修來增進翻譯流程。

我們的解決方案一開始會先利用提示讓 LLM 理解來源內容的脈絡。我們會使用這個脈絡來指引 LLM 的決策判斷與編修作業,並提供評估術語、編修模糊比對以及驗證翻譯句段的指示,進而確保 AI 能在定義的參數範圍內運作。這種做法也讓我們得以持續更新語言提示,萬一發生幻覺時,也能視需要調整與修正問題。

這些測試人員通常是計算語言專家或是具提示工程經驗的語言專家,負責設計、測試與更新我們 AI 譯後編修解決方案的參數。這些語言專家會驗證輸出並提供意見回饋,這些意見接著會用來調整和精進語言提示與參數。